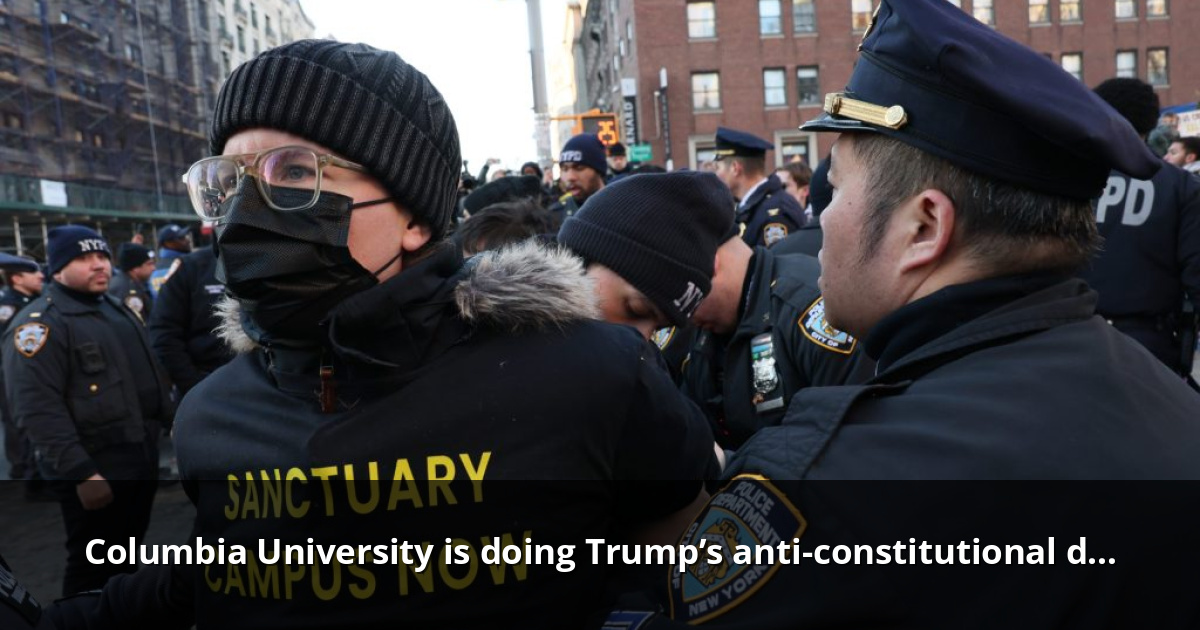

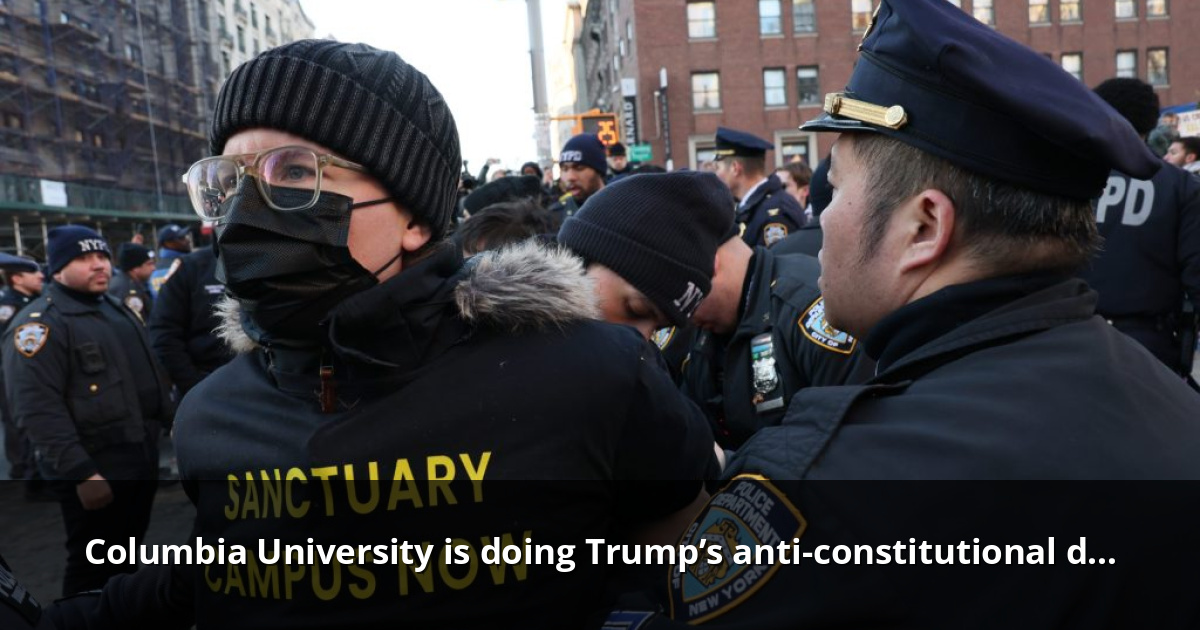

Bending to economic coercion and political pressure from the Trump administration, once-venerable institutions like Columbia University have compliantly become third-party collaborators in the assault on our Constitutional rights. In this episode of the Marc Steiner Show, Marc speaks with Amy E. Greer and Zal K. Shroff, two members of former Columbia student Mahmoud Khalil’s legal team, about how the persecution of Khalil and other Palestine solidarity protestors is reshaping the future of free speech in America.

Transcript

The following is a rushed transcript and may contain errors. A proofread version will be made available as soon as possible.

Marc Steiner:

Welcome to the Marc Steiner Show here on The Real News. I’m Marc Steiner. It’s great to have you all with us. We’ve been standing with and following the ordeal of Mahmoud Khalil since the storm troopers of ICE dragged him from his home on March the 8th. No warrant nothing, just an order from the upper echelons of our government to detain Mahmoud, who was lawfully in our country and a student at Columbia University. His crime (from our perspective)? He stood up for the Palestinian people. We continue following this case and the larger questions this raises for our society’s future. So today we’re once again joined by Amy E. Greer, associate attorney at Dratel & Lewis, and a lead member of Mahmoud Khalil’s team, and another lead member of Mahmoud’s legal team, Zal K. Shroff, assistant professor of law and director of the Equality and Justice Clinic at CUNY Law School in New York City. You can read more about both of them on our website.

So it’s good to meet you, Zal, and good to see you again, Amy. Good to have you both on. Thank you for doing this today.

Zal K. Shroff:

Absolutely.

Marc Steiner:

So let me just start and talk a bit about, on a personal note, how Mahmoud is doing and what is his state at the moment.

Amy E. Greer:

Yeah, sure. I mean we are both working with Mahmoud in different capacities, but I think Mahmoud is doing as well as one can with having an anvil hanging over his head at the moment and the machinery of the administration aiming at him. But he remains steadfast in his commitment to Palestinian rights and dignity and steadfast in his commitment to his family’s safety and wellbeing. So I think those things really ground him and keep him focused at this time.

Marc Steiner:

Zal, do you want to add anything to that?

Zal K. Shroff:

I think what’s really remarkable is that Mahmoud is able to focus on the broader picture of American democracy and what is going wrong here despite his personal risks and exposure. And I think that’s what’s really remarkable. He’s just one of the eight students that we represent in this case, but the only one who is not proceeding anonymously because he’s already been the subject of so much government scrutiny. And so the fact that he’s able to still bear this banner and speak about the importance of free speech for American democracy at this time is really remarkable.

Marc Steiner:

Let’s talk about all that for a moment. I think that it’s really kind of important to talk about what is actually happening here and why Mahmud and the others are being persecuted and prosecuted and what is the underpinning of this assault on their freedom for doing what is legal in Americans to do?

Zal K. Shroff:

Yes, I’m happy to start there. Okay, good. I think that there’s been a profound distraction about what’s really been going on here because what we’re seeing is that the Trump administration in many ways is seeking to exercise coercive control over our private institutions through whatever means that they have available to them. And so they’re using anti-discrimination law in this really ugly and toxic way to actually target the communities that those laws were meant to protect. So we have Title ix, which is supposed to protect against gender discrimination. They’re using that to target universities, to target trans people under the guise of protecting women. They’re doing the same thing with Title Six, which is a race discrimination statute. It’s designed to protect people from race discrimination, and yet it’s actually being used to suppress the Palestinian solidarity movement under the guise of protecting Jewish students. All the while actually Jewish students are being targeted just as much as anyone else if they’re expressing views that are critical of Israel.

And we’re also seeing the same playbook with the grant cancellations, the contract cancellations with law firms. It’s every financial and coercive tool the federal government has to bring to bear. It has brought to bear on our private institutions and what we’re seeing now is the test and the metal of these organizations of whether they’re actually caving to that pressure or they’re fighting back. I think what we’re seeing is that many more organizations than we would like to see are caving. Columbia University is one of those, but across sectors there are so many of those important really large institutions we would actually depend upon to represent us, to fight for us to fight for their constituencies. And instead what we’re seeing is a pre-compliance regime with authoritarian control and that is ultimately going to undermine our democracy.

Amy E. Greer:

Palestine is in this country, has always been the canary in the coal mine. The issue that kind of challenges how comfortable we are in this country with incursions into our rights. So the other aspect and angle of this is also using anybody who’s speaking out for Palestine, for Palestinian rights and dignity are also being used to advance the incursions into the First Amendment. Like Ologists went through incursions into our institutions like Zoologists went through and also rolling back of laws that are going to impact, for example, all people engaged in immigration proceedings, rolling back the rights of all people who face removal proceedings in this country and also rolling back First Amendment rights of people who are not citizens in this country. And Palestine has often been used because people don’t exercise their political capital, their financial capital, their social capital, their academic freedom capital to protect Palestine or people speaking on Palestine or people speaking against Israel. And therefore it changes the goal line for all people, while many of us many remain silent in the face of these incursions into our institutions, into our rights, into our homes and into our communities. So that’s the other facet of this that I think is really critical about what our students are speaking about and what they have been sounding the alarm about since 2023.

Marc Steiner:

And it seems to me that one of the things I was thinking about last that night and this morning about this case and what’s going on in Mahmud is it’s Mahmud has to be free, but it’s beyond Mahmud in the sense that we’re seeing a confluence of events happening here. I mean, it’s the rise of authoritarianism coming out of the right wing movement who’s in control of the government of the United States. It’s silencing protests that are at the heartbeat of America as they’ve always been. I mean, I was at Columbia decades back with Mark Rud and the others when all that happened. Columbia is once again the center of that. And I think that the significance of this moment might get lost in terms of what it actually means. It’s about mahmud’s freedom in his right to be who he is and the others who are also being investigated and prosecuted. But it’s beyond that. This is a fundamental case, it seems to me about the future of our freedoms in this country. I think that’s something that people miss in this. It’s not just a case about a student.

Zal K. Shroff:

That’s absolutely right. And it’s also a case that’s about our constitutional freedoms, our bedrock constitutional freedoms. So I think we’re seeing across the board First Amendment violations from this administration, suppressions of the right to speech suppression of dissent. We’re also seeing massive amounts of excessive force in the context of ice, et cetera. And so I think the moment that we’re in is testing whether or not the courts are going to push back on obvious rights violations and to hold the administration to account. And what we can see is that the institutions that are fighting back, they are winning. So like the general block of the big law firms that fought their administration to say you can’t cancel, cancel are contracts and relationships because you don’t like the clients. We represent a Harvard that says you can’t come after our funding just because you don’t like how we’ve handled protest on campus.

Same thing with the UCLA community. There are so many contexts in which these cases are going forward and they are winning the a UP versus Rubio case that says that it’s unconstitutional to target people for removal proceedings based on their political expression. And so I think we actually are seeing a remarkable amount of movement from courageous people and institutions to fight back against this administration to say and defend what the Constitution actually means. We need more of those institutions and for every institution that doesn’t do that, we’re seeing a retrenchment of our constitutional freedoms. And I think that’s part of the movement that we’re in and part of the moment that we’re in. How do we get more constitutional defenders, more attorneys, more courageous plaintiffs in the mix to fight this administration and the belief that that will actually result in a healthier and stronger democracy in the now.

Marc Steiner:

Do you want to say anything about that as well?

Amy E. Greer:

I mean, I don’t have anything to add to that amazing statement. I would just say to your point also is this country knows well the backlash to effective advocacy. So we saw following the murder of George Floyd, the Dakota Pipeline access Occupy Wall Street, and then going all the way back to civil rights and long before that the black communist movement in the deep south, et cetera, that the government responses to these effective tools of organizing and speaking of a new type of freedom where all people flourish and all creatures flourish and our earth flourishes, et cetera, that there’s always been efforts to criminalize those types of protests or those types of actions. And I would just remind listeners that when people take action that we wouldn’t take ourselves or that we may disagree with, the answer to that is not criminalizing it. The answer to that is not removing those people from this country.

The answer to that is not suppressing violently in the ways that Za described or incurring, making incursions into our institutions. Our job here as a citizenry, and I use that word broadly, meaning all residents within a place who are engaged in that place, our job here is to listen to each other and engage, not to get behind these efforts to suppress, criminalize and other eyes people. We’ve always seen these backlashes and I think what we’re seeing now is the veil is down. There’s no mystery here about what voices are being suppressed and whose bodies are being harmed. And hopefully with that clarity, even in the face of such violence, people can understand what’s at stake here and why these humans and these voices are being silenced in such violent ways, bureaucratically violent and also physically violent ways.

Marc Steiner:

This is one of those cases that seems to me that can set a very dangerous precedent for America if they’re allowed to prosecute Mahmud, push him out of the country, go after the others, take away funding from places like Columbia and other universities. I mean, this is, I said the other day, friend, it reminds me of the movement of the late sixties, but it’s on steroids in terms of the consequences.

Zal K. Shroff:

I mean, I think that’s absolutely right. And it’s really remarkable that Columbia University as one of those supposed bastions of academic freedom is the institution that is caving here. And I think what we’re seeing that is very challenging is when an institution like that is denying its connection to the administration is denying the pressure that it is under, is saying that it doesn’t exist. And then saying that its students aren’t at risk when in fact dozens of students have already been suspended, expelled, had their information shared with Congress in a public way and then disclosed in a public way. The risks to the students are real. The risks to the institution are real, and yet the people at the helm of the institution are complicit in its destruction. And I think that’s the core of the problem for this case, which is it’s very obvious when the federal government threatens constitutional rights, they are to be held to account for that and you can sue them for that.

The question here, and I think the thing that we’re really testing now is this coercive tool that the federal government is using to coerce the private actors. And so can you actually go after these private actors for their complicity? And there is a legal framework to do that, but we’re in an unprecedented moment where we haven’t really had to test that as forcefully as we do now. And so I think that’s where we are in the Columbia case, but also more broadly across the field frankly, of federal government coercion, are the courts going to take this seriously and are they going to use this state compulsion theory to acknowledge the economic reality that in fact, these are not independent actors anymore, they have been co-opted and they are causing constitutional harm Because effectively if the courts don’t do anything about that, we now have a system where the federal government will buy proxy, take away all of our rights through economic coercion of our private institutions. And that’s just not a world that we can live in. And it’s not the world that we live in. That’s not what the civil rights framework says. That’s not the legal avenues that are available to us. But we do depend on the courts and on courageous plaintiffs to bring these cases to actually vindicate those rights against this sort of coercion of our private institutions.

Amy E. Greer:

And I think historians that we’ve spoken to in organizing this case and the theory in this case have really validated everything’s all just outlined, which is whenever this government has successfully made similar types of incursions into private spaces, it has always required the capitulation and or cooperation of private actors, right? Thinking about the McCarthy era and the House on American Activities Committee, et cetera, that time period. And something that I think gets lost in the narrative of that time is how McCarthy and that committee specifically, but other government actors would not have been able to do what they did at the scale they did without these third parties either being coerced into helping, recognizing this sort of subliminal coercion, if you will. If we’re not for, and they perceive us as against then we will be harmed as well or lumped in with these groups of people who are being dragged through here and humiliated and can’t find work and basically have to leave the country in many cases.

And so this just highlights that this is a playbook we’ve seen before in this country, but the scale of it and the access to technology now as well, I think should give us all pause. And so we are testing this theory because it should make us all uncomfortable to see the ways in which places like Columbia and the institutions all has already outlined who we viewed as the first line of defense for these types of incursions are actually either capitulating or cooperating or otherwise becoming that state actor in these types of erosions and incursions into our rights. But WAC scholars have made it very clear that WAC couldn’t have done what it did without those private entities. And I think that’s what we’re seeing exactly what we’re seeing here.

Marc Steiner:

So what you both are describing here is that this is one of the examples happening at the moment of our democracy being on a precipice. And I think the depth of that is not seen by many because people are not following Mahmoud’s case day in and day out. It’s not, I mean, we’re covering it and we’re pushing it out there and we’re talking about it. It needs to be talked about because we are in a very dangerous place. And I wonder, A, how you think this will turn out legally in terms of the work you’re doing, but B, what it would mean if they were allowed to do what they’re doing in terms of taking funding away from schools and throwing Mahmood out of the country. Because if that happens, that just opens the door to greater repression in our country. When I say it’s beyond Mahmud, that’s what I mean.

Amy E. Greer:

I think one of the keys here that is just really critical is the legal system never has and never will save us. It can be, and it is an important strategic tool and it is necessary. And the courts interpreting the law and the constitution to be protective of all of our rights, to be protective of, as the Bible says, the least of these, the people who have been purposefully marginalized and otherized in the society. The legal system has always played a critical role in both the otherizing and marginalizing, but also in the upholding of voting rights, upholding of rights to speech, religious freedom, et cetera. But it is, but one strategy, we as lawyers are part of the broader struggle, but we are not the struggle.

And so I think Zal will bring us home on the other facets of your question, but I just think that that’s speaking for myself as a lawyer, I’m very aware that I am only one piece of this very big pie that we are all in, and that it will take all of us holding power to account, speaking truth to each other, holding power to account together in this push and sort of protective fire line that we’re building. But litigation is not the only strategy and courts shouldn’t be looked at as the only mechanism here. That said, they’re a very critical mechanism. So with that, I’ll hand it over to all. Absolutely.

Zal K. Shroff:

Yeah. And what I’d say to your first point about the under-reporting, I think we’re in a time where power really can control what the truth is. And so I view the legal process as a truth telling process of having a neutral arbiter to actually say what fact is. And I think what we’re experiencing is a tremendous media blitz from the federal government and from Columbia, very well-resourced institutions and entities who are simply in denial mode. And so the federal government says, oh, we would never coerce Columbia to do anything. They made all these choices by themselves. Well, if you look at the record, $400 million of funding pulled one week later changes from Columbia. That sure looks like government coercion. And then again, Columbia changes its definitions of speech that’s prohibited on campus. And then one week later they’ve got their funding restored in a contract with the federal government.

And the same thing from Columbia. They say, oh, why would our students be afraid of us? We would never target students for their political expression. And they can say that in the same couple of weeks that they’ve disciplined 80 students and either sent them home or suspended them or done something else egregious to their futures. And so I think that that denial and that publication of the nothing to see here is very difficult to counteract. And the legal process is one of the ways that we do that truth telling, but it also has teeth to it. There’s coercive power in the right of access to courts. And so what we’re seeking in this lawsuit is an end both to the financial pulls from the federal government, stopping them from using their purse strings as a way to control Columbia, like a marionette stopping that, and then also stopping the individual disciplinary proceedings that all these students are experiencing that are clearly only there to target their political advocacy.

And so I think the core process can do both of those things. It does the truth telling of what is actually happening on this campus from the experience of people who are going through it, and then also what is the remedy that we have a right to as the public to stop this from happening to us? Both are possible through this lawsuit. And as Amy said, nothing is possible without the courage and coordination of the people who are living this experience and doing this work and movement building. But the court has a really critical role to play in the truth telling and the compulsion of the government back to what we need it to be. So I think that’s where we’re situated in the lawsuit, what we expect to be the outcomes from this lawsuit. And I think when we are successful with that, if we are successful with that, we will actually see more cases like that across the country that are holding the administration to account, and we will see that fight for our democracy reinvigorated. I think that’s what we really need to see in this moment to give us all hope of what comes next.

Marc Steiner:

So as we close out here, I have to ask you A, how is Mahmood doing in this struggle? Because he’s up against the wall with what they’re attacking him with, and B, as you excited earlier, people don’t realize that 80 other students are being affected. Their lives have been affected, that they are being pushed out of a university. Everything they put into it, those are factors that are on a personal and a political level that are really critical that people need to understand what’s taking place here. This is reminiscent of what the McCarthyite era did in the fifties in destroying people’s lives. And that’s what we’re witnessing right now.

Amy E. Greer:

Yeah, with technology, because now once people are dragged through the mud like this, those profiles, those videos, all of those smears are findable. They don’t really ever disappear. But I think one thing I’ll just say is part of the impetus for this case, which is Klio versus Columbia University board of Trustees, and there’s multiple plaintiffs and multiple defendants, but one of the impetuses for this case was the House Committee on Education and Workforce was demanding that Columbia turnover records of their students to the federal government for exercising their protected political speech. And now also in the July, 2025 agreement between Columbia and the federal government, there are multiple paragraphs that specify that Columbia will have to hand over more student data, particularly when they’re exercising their protected political speech to the federal government. And so something that’s just really critical to highlight here is these coercive mechanisms.

It’s not, it is about funding. And obviously that helps the institution protect its business interests over its students and its faculty. But the other component of this is that they become a provider. They’re an identifier, a targeter, a gathering of information that then gets turned over to the federal government. And that should give all of us pause about what that means for our engagement with institutions, whether it be as a student, a worker, because these tactics, if successful, mark my words, they will be and have been expanded to unions. They’ve been expanded to professional associations like the American Psychological Association, and they will expand. As long as these organizations are happy to capitulate or maybe not happy, but feel required or coerced, capitulating, their people are in their information, their private speech, their private associations, their rights, they’re the ones who are going to feel trampled on.

And what happened to Columbia students is once they learned that material was being turned over, it had an incredible chilling effect on their speech. They were worried about walking together with friends on campus because their friend happened to have a student visa and they didn’t want their advocacy to be imputed to their friend who was on a student visa where they would face removal from this country potentially violently or to a third country. I mean, who knows? And students were afraid to speak up in class because they were being videoed. And somehow those private videos made their way into the hands of the government. And so all of these layers of sort of Foucault’s panopticon of people just being watched and having all their stuff turned over their private lives turned over to the federal government was the basis of this case. And it’s a model that I think just as we are litigation as a model of how to stop this, if this is also a model the government hopes to repeat, I think.

And so that’s why we are here doing what we’re doing. And Sol may have more to add to that, but I think that it’s really critical to understand why we brought this civil suit and why Mahmoud was brave enough to bring it from detention. We had already been planning to bring it obviously in the months leading up to his abduction and detention. But why he said he wanted to go forward from detention is because like Zal said so beautifully at the beginning, he saw the writing on the wall and he saw how many people were going to be impacted by this becoming some kind of presidential behavior. And also if the courts don’t weigh in here, how this could really start to harm many communities and not just him individually.

Zal K. Shroff:

Absolutely. And I think to your point about the fact that the public doesn’t realize how many students are impacted here, I think one of the roles of this case is to uplift the experience of as many students as possible.

And Amy and her colleagues have spoken to dozens of students who have had this experience, who have reported just awful treatment by the university and targeting and profound consequences of their lives not being able to apply to graduate school, missing precious employment opportunities, all because of these sham investigations that say that these are people who are engaging in discrimination when they’re doing is engaging in political advocacy. And again, that’s all at the behest of the Trump administration and Columbia going along with it. And I’d say for every student we know about, there are many that we actually don’t know about because of their fear about coming forward to talk about this experience. And so through the process of discovery in this case, we will come to understand the extent of harm that Columbia has caused here and the number of students that it has put through the ringer through this process.

And I think part of our job will be to share that with the public, with the press to get the word out about what exactly has gone on here. And so you’ll see even in the filings for the case thus far, we’ve actually posted to the public docket with students’ consent, the exact things that they’ve been accused of and targeted for and then punished for. And you’ll see how remarkably innocuous some of those things are passing around a flyer that says that Columbia’s definition of antisemitism is actually antisemitic in itself. Jewish students being targeted for that, students being targeted for going to a silent protest. These are the things that we’re seeing and having to contend with that the public is not aware of. And so I think part of the truth telling of the case will be bringing that to light and having the court uplift that. So it’s part of the public record.

Amy E. Greer:

And the one thing I just want to, I thought of this, and I just want to emphasize this. I have heard from people in regular conversation and seeing back when I was still on social media, people kind of talking about these colleges and university students who are speaking out for Palestinian rights and trying to endo genocide, that it’s like privileged white kids who just let the consequences come because whatever you’ve heard, I’m sure many people have heard those kinds of things. I just want to be really crystal clear about who has been most harmed by these policies intentionally. And they’re students of color, particularly Palestinian, Arab and Muslim students, south Asian students, black students, first generation students who see themselves in the Palestinian struggle for liberation and who are putting their whole lives on the line. They have lost housing. They have lost their student visas, they have lost in some cases job prospects that Zal already outlined.

They have lost access to medical care, they have lost access to food. Some of these kids are couch surfing because they lost their access to residential housing for all. First saying that genocide is wrong and that they don’t want to be part of an institution that contributes to the genocide of a people, many of whom whose skin colors or belief systems or families are resonant with their own and their own histories and struggles for liberation and for freedom and for life to live and thrive as they are in this world with the bodies that they’re in, with the identities they hold. And so I think that’s a really critical piece here to just, I know I look how I look, and I am a messenger for this, but I do not resemble our plaintiffs and I do not resemble so many of the students who have put everything on the line yet again as their forebearers have in this country always been the shoulders we’re standing on when it comes to protecting rights and working towards a society that where all people flourish.

Marc Steiner:

Am glad you closed it that way. And I think it’s important for everybody to hear these things and understand what’s going on. I’ll just say to both of you, and thank you both for being with us today, but also that the airwaves here at The Real News and my show in particular are open to you, to Mahmood, to whoever you need to bring on to continue keeping this in front because it’s a battle for their freedom. It’s a battle for academic freedom, it’s a battle for the future of our democracy, and you all are in the middle of it. So I want to thank you both so much for what you do and for taking the time for this today.

Amy E. Greer:

Mark, thank you so

Zal K. Shroff:

Much.

Amy E. Greer:

Thank you so much.

Marc Steiner:

Thanks to David Hebden for running the program today and audio editor Stephen Frank for working his magic, Rosette Sewali for producing the Marc Steiner Show, and the tireless Kayla Rivara for making it all work behind the scenes. And everyone here at the Real News for making this show possible. Please let me know what you thought about, what you heard today, what you’d like us to cover. Just write to me at mss@therealnews.com and I’ll get right back to you. Once again, thank you to Amy Greer and Zal Shroff for the work they do and for joining us today. So for the crew here at The Real News, I’m Marc Steiner. Stay involved. Keep listening and take care.

[Zdroj: xStation 5]

[Zdroj: xStation 5]